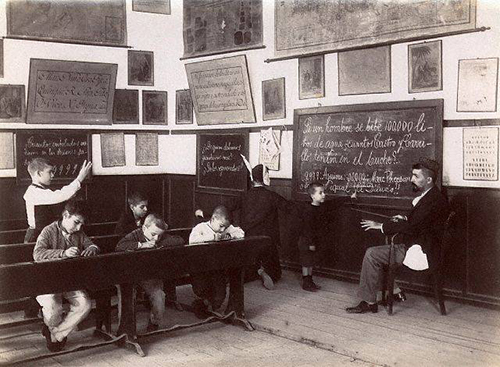

Con mayor o menos flexibilidad, el entrenamiento humano siempre ha estado guiado por profesores y libros de texto o en las últimas décadas, material digital. El conocimiento general que se nos transmite en cualquier tipo de aulas no está protegido por derechos de autor y cuando toca leer una obra, ya sea clásica o moderna que sí tiene derechos de autor, los alumnos se compran el libro y el autor se beneficia de la difusión de su obra.

Si hay un ávido lector que no puede o no quiere pagar por cada una de las obras que vaya a leer, opta por bibliotecas, en las que ejemplares de un libro se ponen a disposición del público general. En ese caso el autor recibe una compensación conocida como préstamo público (no afecta a los préstamos que se hacen para lectura en las bibliotecas a los que se hacen entre las propias bibliotecas o a personas con discapacidad) que en España gestiona Cedro, con fondos de la Administración Pública. También existe la compensación por copia privada que se paga por las supuestas copias que los lectores realizan de cualquier obra, en este caso se financia desde las empresas fabricantes de dispositivos y soportes de grabación y también lo gestiona Cedro en nuestro país.

Así que la formación, el entrenamiento del ser humano, SÍ paga derechos de autor. Todos contribuimos a que haya personas que dedican su vida a la creación, ya sea escrita, visual, física… Las artes nos hacen más humanos, encierran la esencia de las emociones y ayudan a innovar, a tener una mente crítica por lo que activan el progreso.

El problema surge cuando hay que formar/entrenar a esos nuevos entes digitales: las IAs. Igual que un niño debe recibir clases para aprender, con la diferencia de que tiene una capacidad de asimilación y retención muy superior a la del ser humano, estratosféricamente superior. Las primeras, yo diría que OpenAI, se formaron a lo largo de años. Era una empresa sin ánimo de lucro que pretendía crear una IA al servicio de la humanidad, para ayudar a innovar, dar con soluciones a problemas históricos (tanto a nivel médico, como social o económico) y facilitar el acceso al conocimiento a toda la Humanidad.

OpenAI se funda en 2015. Los padres fundadores fueron: Sam Altman, Elon Musk, Ilya Sutskever, Greg Brockman, Trevor Blackwell, Vicki Cheung, Andrej Karpathy, Durk Kingma, John Schulman, Pamela Vagata, and Wojciech Zaremba. Sus intenciones quedaron escritas:

Should be an extension of individual human wills and, in the spirit of liberty, as broadly and evenly distributed as possible

Un grupo de inversores (Sam Altman, Greg Brockman, Elon Musk, Reid Hoffman, Jessica Livingston, Peter Thiel, Amazon Web Services (AWS), and Infosys ) se comprometió a dotar a la empresa con una financiación de 1.000 millones de USD, pero hasta 2019 realmente solo recibieron $130 millones.

Empiezan el desarrollo de las bases del motor IA. En 2016 sacan dos productos para entrenar otras IAs con recursos disponibles en Internet. En ese espíritu de estar haciendo algo bueno para la humanidad, Nvidia les regala un superordenador para que puedan entrenarla con mucha más información. Siguen avanzando y en junio de 2018 lanzan la primera versión de GPT-1 que manejaba 117 millones de parámetros.

Durante los siguientes años se sigue formando/entrenando. Y en 2019 Sam Altman se convierte en CEO. No habían conseguido la financiación que necesitaban y es difícil atraer talento, así que empieza a cambiar aquí y allá. El primer cambio importante es pasar de ser una empresa ‘sin ánimo de lucro’ a una ‘capped profit’, es decir que se empieza a reconocer un retorno para el inversor, pero está “capado”: el límite lo fijaron en 100 veces el capital invertido. En ese momento plantean un plan de opciones entre sus empleados, llegan a un acuerdo con Microsoft de inversión de 1.000 millones de USD y con su servicio Azure de computación en la nube y anuncian que sacarán una versión comercial en menos de cinco años.

En 2020 la fundación lanza una API que permite a otros desarrolladores usar su IA/motor, en ese momento maneja 175.000 millones de parámetros. Pero su lanzamiento estrella no es hasta noviembre de 2022, con GPT-3.5 que en pocos meses consigue 100 millones de usuarios. A esas alturas ya no comparten cuántos parámetros gestiona y Microsoft, con esa cifra de usuarios, empieza a ver el color del dinero a su inversión y firma una ampliación al acuerdo de 2019.

GPT se sigue entrenando, pero ya en 2023 no es una fundación sin ánimo de lucro. Había dejado de serlo en 2019, pero como no había resultados, tampoco pasaba nada. En 2023 no hay beneficios, pero se intuye que, si en 3 meses ha conseguido 100 millones de usuarios, los habrá. El público general empieza entonces a preguntar cómo se ha entrenado, qué fuentes ha usado, cuántas fuentes, pero esa información ya no es pública.

Comienzan los problemas. Esto de convertir una fundación en una máquina de hacer dinero, de cambiar la filosofía de desarrollar para el bien de la Humanidad a que se beneficie el mejor postor, abre heridas internas que ponen de patitas en la calle, en noviembre de 2023, al presidente Greg Brockman y a Sam Altman precursor de la ‘privatización’ de GPT. Hay 4 días de locura, Microsoft dice que contrata a Altman y a todo el equipo de OpenAI para seguir el desarrollo desde Microsoft, dimiten unos, se hacen ofertas a otros… Y al final Altman vuelve y los que quedaban en el consejo de Administración que querían que los resultados de tantos años de trabajo e investigación revertieran en la Humanidad, como se había acordado en 2015 cuando empiezan la aventura, salen con el rabo entre las piernas y empiezan sus propios proyectos de IA.

Y cuando ya queda claro que OpenAI no es una fundación, tienen ánimo de lucro y van a exprimir lo que han desarrollado hasta su última gota, empiezan las demandas. La primera es Elon Musk en febrero de 2024 por poner los intereses comerciales por delante de los de la Humanidad (esto es cosecha propia: sin tener en cuenta sus propios intereses), después se sucede un rifirafe sobre este tema, con muchos matices legales/financieros de cuánto vale la ‘non profit’ que Musk intentó comprar… Para que al final, hace unos días, OpenAI haya anunciado su restructuración definitiva a empresa comercial de forma que puede financiarse como quiera, con la vía abierta a una posible salida a bolsa. El color del dinero ganó y como esto ya no es para el bien de la Humanidad y el motor de GPT se usa en muchísimas de las IAs que hoy nos hace vídeos, imágenes, textos, marketing, temas legales… surge el gran conflicto. Que empezó a surgir a principios de 2023 con los 100 millones de usuarios.

¿Por qué no se ha pagado a todos los creadores que alimentan a la bestia? ¿Cómo puede ser que se haya formado a ‘alguien’ sin pagar lo establecido en el sistema que rige hoy el mundo?

Si era sin ánimo de lucro, tendría un pase. Si revirtiese en la Humanidad, no creo que hubiese problema, pero cuando se usan recursos ajenos para sacar un rendimiento comercial, el dueño de los recursos pregunta ¿y a mí porqué no me han pagado?

Una pregunta legítima que se se está materializando en diversas demandas individuales y colectivas:

La de George Martin contra OpenAI por crear una secuela de ‘Juego de Tronos’

La del colectivo de autores contra Anthropic (estos son de los ex empleados que salieron en la quema)

Un colectivo de autores contra OpenAI

Autores y editores franceses contra Meta

Disney y Universal contra Midjourney

Autores visuales contra Stability AI y Midjourney

Le he pedido a GPT que me haga una lista de demandas: que incluyo

🗂️ Mapa de demandas de autores contra empresas de IA (2025)

1) Autores literarios → OpenAI

- Demandantes: más de 9.000 escritores (incluyendo George R. R. Martin, John Grisham, Jodi Picoult).

- Motivo: uso no autorizado de libros con copyright para entrenar modelos; generación de derivados sin permiso.

- Situación: demanda colectiva en marcha; aún sin resolución.

- Relevancia jurídica: es el caso de escritores más grande del sector. Si prospera, puede obligar a licencias masivas o acuerdos estructurales.

2) Autores literarios → Anthropic

- Demandantes: varios autores (Andrea Bartz, Charles Graeber, Kirk Wallace Johnson inicialmente; después se amplió).

- Motivo: uso de copias no autorizadas y, presuntamente, piratas para entrenar el modelo Claude.

- Situación:

- Un juez declaró parte del entrenamiento como fair use, pero no la creación de una “biblioteca” interna con copias piratas.

- Acuerdo extrajudicial en 2025: Anthropic pagará 1.500 millones de USD.

- Relevancia: es el primer caso de compensación multimillonaria por uso de obras en entrenamiento. Marca un antes y un después.

3) Autores franceses / editoriales → Meta

- Demandantes: tres asociaciones de editores y autores en Francia.

- Motivo: uso de obras con copyright para entrenar LLaMA sin licencia.

- Situación: demanda en curso en tribunales franceses.

- Relevancia: podría fijar criterio europeo sobre entrenamiento en IA, muy distinto al estadounidense.

4) Autores literarios → Apple

- Demandantes: grupo de escritores en EE. UU.

- Motivo: uso de libros con copyright en Apple Intelligence sin permiso.

- Situación: causa en curso.

- Relevancia: primera gran ofensiva contra Apple en este terreno.

🎨 Demandas de artistas visuales

5) Artistas → Stability AI / Midjourney / DeviantArt

- Demandantes: Sarah Andersen, Kelly McKernan, Karla Ortiz (entre otros).

- Motivo: entrenamiento de modelos con millones de imágenes protegidas sin permiso.

- Situación: casos fragmentados; algunos contra Stability avanzan, otros contra Midjourney/DeviantArt han sido parcialmente desestimados.

- Relevancia: son las demandas que han moldeado la conversación pública sobre “estilo artístico” y plagio algorítmico.

6) Estudios cinematográficos (Disney, Universal, etc.) → Midjourney

- Demandantes: grandes productoras.

- Motivo: generación de imágenes similares a personajes y propiedades intelectuales registradas.

- Situación: demanda presentada en 2025.

- Relevancia: las majors entran al campo; aquí la discusión no es solo entrenamiento, sino outputs.

📰 Otros casos relevantes

7) Autores → Meta (caso separado en EE. UU.)

- Fallo en 2025 donde un juez dictaminó que el entrenamiento de Meta era suficientemente “transformativo” para ser fair use.

- Relevancia: primera victoria fuerte para una Big Tech en este terreno.

🧭 Lo que está en juego (síntesis)

- Estados Unidos: los jueces están explorando cuánto del entrenamiento puede considerarse fair use.

- Europa: se perfila un enfoque más restrictivo (mayor protección al autor).

- Precedente crítico: el acuerdo de Anthropic demuestra que los litigios pueden desembocar en compensaciones masivas.

- Escenario probable a medio plazo:

- licencias obligatorias de grandes catálogos,

- identificación clara del origen de los datos,

- y sistemas que permitan entrenar solo con contenido autorizado.

Y con este resumen, digo yo: ¿tiene precio el entrenamiento? Yo creo que debería y a la siguiente pregunta es: ¿quién lo paga? Deberían ser las empresas que desarrollan los motores. Pero claro, esto, a nivel mundial, ¿cómo se gestiona? Con los millones de creadores que hay y sin un catálogo de las creaciones y sin saber que parámetros maneja cada IA…

No sé yo si se llegará a ese ‘fair use’ en la IA del que tanto se habla con todas las demandas abiertas y las que están por llegar. No lo sé, pero debería.

Descubre más desde Sylvia García

Suscríbete y recibe las últimas entradas en tu correo electrónico.